Komputer na parę? Zobacz niesamowity projekt Charlesa Babbage’a

W XXI wieku komputery są wszędzie — tak bardzo, że często przestajemy je zauważać. Sterują tym, jak rozmawiamy, jak pracujemy i jak podróżujemy, a nawet wspierają misje, które sięgają poza granice Ziemi. Potrafią ułatwić codzienność… albo wciągnąć nas w świat VR, z którego trudno się oderwać. Tylko jak to się stało, że niepozorne maszyny do liczenia przeobraziły się w fundament współczesnej cywilizacji? Ta historia ma kilka zaskakujących zwrotów.

- Jak zdefiniować komputer i jego początki

- Od Zuse do zimnej wojny: narodziny komputerów

- Od tranzystora do pierwszego peceta

Jak zdefiniować komputer i jego początki

Przepis na komputer

Komputerem można nazwać każdą maszynę, która potrafi odczytywać i wykonywać zapisane (zakodowane) polecenia. Tym, co najbardziej odróżnia komputer od zwykłego kalkulatora, jest możliwość programowania. Nawet najstarsza maszyna analityczna z XIX wieku (do której jeszcze wrócę) była w teorii zdolna uruchomić program. Podstawy architektury komputerów opisali dwaj wybitni matematycy w latach 30. i 40. XX wieku – Alan Turing (Ritchie D., 1986: s. 77) oraz John von Neumann. Żeby urządzenie mogło działać zgodnie z tym opisem, musi spełniać kilka kluczowych warunków:

- urządzenia wejścia-wyjścia przyjmują instrukcje i oddają wyniki

- pamięć przechowuje dane (zmienne) oraz instrukcje

- jednostka arytmetyczno-logiczna wykonuje operacje i przetwarza informacje

- jednostka sterująca ma dostęp do pamięci i nadzoruje realizację przyjętych poleceń.

Komputer potrzebuje też własnego źródła energii. W odróżnieniu od suwaka logarytmicznego, mechanicznych kalkulatorów czy arytmometrów działa w pełni automatycznie. I właśnie ten wymóg sprawił, że realna budowa komputera stała się możliwa dopiero w XIX wieku. Ludzie od stuleci posługiwali się kodami liczbowymi i rozmaitymi urządzeniami, także maszynami liczącymi, ale większość pracy wykonywano w głowie, na papierze albo – w najlepszym razie – dzięki ręcznym mechanizmom: dźwigniom, sprężynom, kołom zębatym czy ciężarkom. Przełom nastąpił dopiero wtedy, gdy do powszechnego użytku wszedł udoskonalony silnik parowy.

Maszyna Babbage’a i pierwsza programistka

Pierwszy programowalny komputer w historii miał czerpać energię właśnie z silnika parowego. W 1822 roku angielski wynalazca Charles Babbage skonstruował pierwszą maszynę różnicową. Nie był to jeszcze komputer, lecz raczej ogromny, mechaniczny i zautomatyzowany kalkulator. W kolejnej dekadzie rozpoczął prace nad maszyną analityczną, która miała już wszystkie podstawowe cechy dzisiejszych komputerów. Była programowalna (za pomocą kart perforowanych – rozwiązania zapożyczonego od Jacquarda), miała wydzieloną część pamięci oraz jednostkę analityczną. Napęd parowy umożliwiał jej automatyczną pracę. (Petzold Ch., 2002: s. 267-268) Projekt nigdy nie został ukończony. W czasach Babbage’a był po prostu zbyt drogi. Koszt i skomplikowanie konstrukcji nie odpowiadały ówczesnym potrzebom – skomplikowane obliczenia dało się przecież wykonywać przy pomocy liczydeł, niewielkich arytmometrów obsługiwanych ręcznie oraz suwaków.

Współpracownicą Babbage’a i autorką pierwszych programów była Ada Byron-King, księżna Lovelace. Była córką słynnego romantycznego poety George’a Byrona oraz wszechstronnie wykształconej (m.in. w matematyce) Anny Izabeli (Anabelli) Byron. (Petzold Ch.: s. 268)

Od Zuse do zimnej wojny: narodziny komputerów

Projekt Konrada Zuse

Za jednego z pierwszych twórców komputera w dzisiejszym znaczeniu uznaje się niemieckiego inżyniera Konrada Zuse. W 1936 roku opatentował rozwiązanie pamięci, z której dane mogła odczytywać jednostka sterująca maszyny. Mechanizm opierał się na automatycznie przesuwanych blaszkach. Dwa lata później zbudował prototyp V1, który później otrzymał nazwę Z1. Najbardziej przełomową ideą Zuse było wprowadzenie zapisu binarnego, czyli opartego na zerach i jedynkach. Taki sposób zapisu pozwalał przedstawiać nawet bardzo duże liczby jako odpowiednio długie sekwencje prostych impulsów elektrycznych. I co ważne, niósł dodatkową korzyść: łatwo było przejść od rachunków na liczbach do operacji logicznych, gdzie zamiast 0 i 1 pojawiają się „prawda” oraz „fałsz”.

Z1 powstawał dzięki wsparciu społeczności — w praktyce rodziny i znajomych młodego konstruktora. Prototyp nigdy nie działał w pełni niezawodnie, ponieważ mechaniczne blaszki często zawodziły. Ostatecznie urządzenie zostało zniszczone podczas bombardowania Berlina w 1943 roku.

Pierwszym w pełni programowalnym komputerem Zuse był model Z3, niestety wykorzystywany przez niemieckie lotnictwo w czasie II wojny światowej. (Lee J.A.N.: s. 765-766) Sam Zuse nie był ideologicznie związany z III Rzeszą, ale też nie działał w opozycji — należał do grupy naukowców i inżynierów, którzy po prostu wykonywali swoją pracę. Niezależnie od kontekstu historycznego jego koncepcje okazały się przełomowe. Kolejne maszyny Zuse służyły już także do obliczeń naukowych i zastosowań komercyjnych. Po wojnie prowadził firmę Zuse KG, która z czasem została przejęta przez koncern Siemens.

Enigma i pierwsze komputery

II wojna światowa stała się momentem zwrotnym w historii komputerów. Zdalna komunikacja idealnie odpowiadała potrzebom militarnym, ale miała poważną słabość — przeciwnik mógł przechwycić rozkazy, podłączając się do sieci kablowej albo nasłuchując właściwej częstotliwości radiowej. To właśnie dlatego błyskawicznie zaczęły rozwijać się metody szyfrowania. Pod koniec I wojny światowej Artur Schreibus zbudował maszynę szyfrującą, którą opatentował w 1918 roku, a od 1923 sprzedawał pod handlową nazwą Enigma. Pod koniec lat 30-tych po Enigmę sięgnęło wojsko III Rzeszy. Innym urządzeniem używanym przez niemieckie dowództwo była maszyna Lorenza.

Złamanie wiadomości szyfrowanych Enigmą i maszyną Lorenza było kluczowe dla przewidywania działań przeciwnika — liczyły się czas i bezbłędność. Właśnie dlatego zdecydowano się wykorzystać maszyny analityczne. Colossus, zbudowany w 1943 roku, bywa uznawany za pierwszy cyfrowy, binarny i programowalny (ręcznie) komputer. Jego zadaniem było łamanie przekazów nadawanych dalekopisem i szyfrowanych przez maszynę Lorenza. Do atakowania szyfru Enigmy używano z kolei urządzenia mechaniczno-elektrycznego o nazwie Bomba, skonstruowanego jeszcze przed wojną przez polskich kryptologów. Brytyjska Bombe została później dostosowana do nowych metod szyfrowania wprowadzonych przez Niemców po rozpoczęciu wojny. Przy pracach nad Colossusem i Bombe uczestniczył m.in. Alan Turing — twórca koncepcji hipotetycznego komputera wzorcowego, znanego jako maszyna Turinga. (Ritchie D.: s. 78-79)

Zimna wojna i komputerowy boom

Najbardziej dynamiczna fala cyfryzacji przypadła na lata 1945–1989, czyli okres zimnej wojny. Sprzyjało temu wiele czynników: powojenny boom gospodarczy w USA, dostęp do surowców, szybkie upowszechnianie się technologii oraz zaplecze przemysłowe. Sama wojna zmusiła obie strony do gwałtownego przyspieszenia rozwoju rozwiązań, które były znane już wcześniej. Później potrzebę dalszych ulepszeń napędzał zarówno wyścig zbrojeń i rywalizacja kosmiczna, jak i rosnące zastosowania komercyjne oraz społeczne. Pokolenia urodzone po II wojnie światowej coraz częściej widziały w komputerach narzędzie do rozrywki, komunikacji i ułatwiania codziennych obowiązków. Powróciły też przedwojenne marzenia o tym, że maszyny będą wyręczać ludzi — a gdy komputery weszły do użytku, te wizje przestały brzmieć jak fantazja i zaczęły nabierać realnych kształtów.

Od tranzystora do pierwszego peceta

Tranzystor i prawo Moore’a

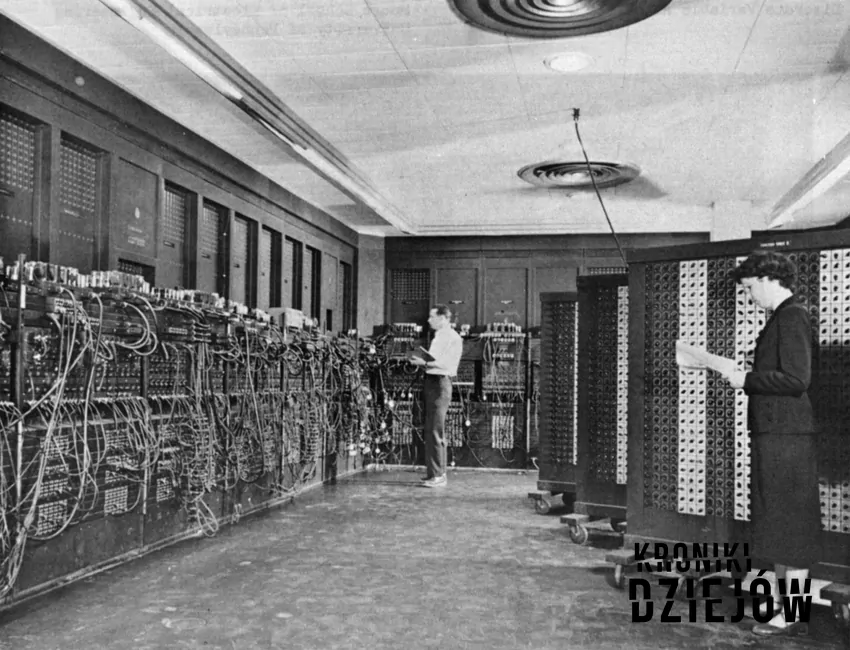

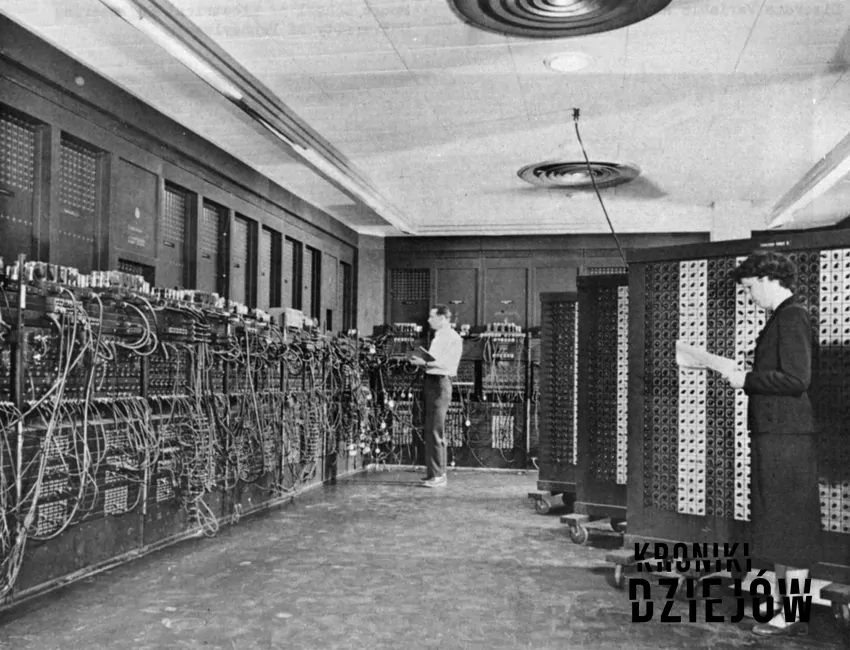

W 1946 roku pierwsze komputery miały już wszystkie kluczowe elementy, o których wspominałam wcześniej. Ich sposób działania i ogólna architektura nie odbiegały zasadniczo od tego, co znamy dziś. Różnica była taka, że zajmowały ogromną przestrzeń i wymagały stałej opieki wykwalifikowanych operatorów.

Spośród wielu wynalazków, które usprawniły pracę maszyn liczących, pozwoliły je zmniejszyć i znacząco przyspieszyć, szczególne miejsce zajmuje tranzystor.

Tranzystor to element układu elektronicznego zdolny do wzmacniania sygnału elektrycznego. Zanim się pojawił, podobną funkcję pełniły lampy próżniowe. Ich gabaryty skutecznie hamowały miniaturyzację pierwszych komputerów i utrudniały budowę mniejszych, bardziej praktycznych urządzeń.

Podstawą działania tranzystora jest materiał półprzewodnikowy. Najczęściej wykorzystuje się krzem (silicon) — i właśnie od niego wzięła się nazwa elektronicznego „el dorado”, czyli „Dolina Krzemowa” (Silicon Valley). Pierwszy działający tranzystor powstał w laboratoriach Bella w 1947 roku. (por. Ritchie D.: s. 120) W latach 50-tych konstrukcję intensywnie doskonalono, aż w 1958 roku Jack Kilby i Robert Noyce, niezależnie od siebie, zbudowali pierwsze układy scalone oparte na tranzystorach.

Gdy tylko na rynku pojawił się sprawny tranzystor, szybko rozpoczęły się próby wykorzystania go w komputerach. Prawdziwy przełom przyniósł jednak dopiero układ scalony — to on stał się fundamentem dynamicznego rozwoju komputerów (i całej elektroniki). Tempo zmian było tak duże, że około 1965 roku George Moore, późniejszy współzałożyciel Intela, zauważył, iż liczba tranzystorów w układzie scalonym będzie podwajać się co roku. To właśnie tzw. prawo Moore’a, które w kolejnych latach modyfikowano i zaczęto odnosić także do innych parametrów komputera, t.j. pojemność pamięci czy szybkość taktowania procesora.

Od minikomputera do Altair 8800

Dziś moglibyśmy się uśmiechnąć, widząc co pod koniec lat 60-tych nazywano minikomputerem. Jeden z pierwszych modeli — PDP-8 — przypominał średniej wielkości szafę, i to bez wliczania urządzeń peryferyjnych. Z kolei potężne, wieloczęściowe komputery typu mainframe, używane w dużych organizacjach, kosztowały tyle, że większość małych firm nie mogła o nich marzyć — a o zastosowaniach domowych nie było nawet mowy. Minikomputery projektowano z myślą o bardziej powszechnym użytku. To właśnie one utorowały drogę komputerom osobistym: były mniejsze, a wprowadzanie danych za pomocą przełączników okazywało się prostsze i bardziej dostępne.

Wśród prekursorów PC-ta historycy cyfryzacji najczęściej wskazują Altair 8800, oparty na procesorze Intel 8080. Model wprowadzony przez firmę MITS był jednym z pierwszych komputerów, na które realnie mógł sobie pozwolić prywatny użytkownik. Była to wersja skrajnie minimalistyczna: bez pamięci zewnętrznej, bez klawiatury i bez typowych urządzeń wejścia. Jednocześnie, jak na tamte czasy, zaskakiwał rozmiarem — mieścił się mniej więcej w formacie dużej walizki.

To, że Altair 8800 stał się dostępny, otworzyło drogę do komputerów, z których faktycznie mogli korzystać niemal wszyscy. Jego przydatność dla osób bez specjalistycznej wiedzy wyraźnie wzrosła, gdy w 1975 roku Bill Gates i Paul Allen napisali Altair Basic (później nazwany Microsoft Basic), bazujący na opracowanym wcześniej edukacyjnym języku Basic. (Lee J.A.N., 1995: s. 413) Następne ulepszenia sprawiły, że dość surowa maszyna, jaką był „goły” Altair 8080, zaczęła przypominać pełnoprawny komputer osobisty — z oprogramowaniem, grami i możliwością nauki. Po podłączeniu monitora i klawiatury dało się z niego korzystać w normalny, wygodny sposób.

II połowa lat 70-tych i początek lat 80-tych przyniosły kolejne kroki naprzód w rozwoju komputerów osobistych. Miniaturyzacja szła w parze z rosnącą wydajnością — urządzenia stawały się mniejsze, a jednocześnie coraz bardziej użyteczne.

Można dyskutować, jakie wydarzenie naprawdę rozpoczęło erę cyfrową, ale jedno nie ulega wątpliwości: to upowszechnienie internetu ostatecznie ją przypieczętowało. Komputery osobiste nie tylko stały się powszechnie dostępne i prostsze w obsłudze, lecz także otworzyły drzwi do światowej bazy informacji. Ale to już temat na osobny artykuł.

Źródła:

- Charles Petzold, Kod. Ukryty język sprzętu komputerowego i oprogramowania, Warszawa 2002

- David Ritchie, The computer pioneers: how the modern computer was created, New York 1986

- John A.N. Lee, International biographical dictionary of computer pioneers, Chicago 1995